0

0

L’intelligence artificielle nous concerne tous.

Nous sommes tous "patient" à un moment donné de notre vie. Que nous ayons un rhume ou une jambe cassée, l'IA est parfois présente. Certaines personnes se posent énormément de questions quant à la manière dont ils seront pris en charge par cette technologie :

Les patients peuvent-ils choisir de se faire diagnostiquer par une IA ?

L'IA engendre-t-elle un coût supplémentaire ?

Le médecin aura t-il un droit de regard sur les résultats ? Sera-t-il présent ?

Ces questions convergent vers un inévitable débat autour de l'éthique, notamment dans la relation patient-médecin.

Pourrais-je avoir confiance en une machine comme j'ai confiance en mon médecin ?

Est-ce que le côté humain s'effacera au profit de la technologie ?

Le monde médical sera-t-il déshumanisé ou au contraire va-t-il améliorer certaines méthodes ?

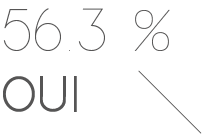

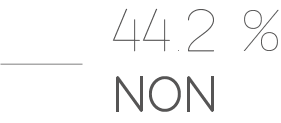

Auriez-vous confiance en l’Intelligence Artificielle pour votre santé ?

La question a été posée à un panel de 190 personnes composé à 65,1% de femmes et 34.9% d’hommes.

Seriez-vous prêts à vous faire diagnostiquer par une IA ? Auriez-vous confiance ?

Nous avons posé la question à plusieurs personnes pour avoir leur avis.

« L'IA N'EST QU'UN OUTIL DE PRODUCTIVITE AU SERVICE DES SOIGNANTS POUR LES PATIENTS »

Patient anonyme

« LE ROBOT EST PROGRAMME POUR DETECTER LES CELLULES CANCEREUSES DE LA PROSTATE. CA CHANGE LA DONNE, SANS CE ROBOT, ON SE LA FAIT ENLEVER AVEC LES COMPLICATIONS. »

Christian Le Corre, patient à l'hôpital Haut Lévêque (CHU) de Pessac, prochainement opéré par un robot.

« CERTAINES PERSONNES ENVISAGENT QUE LA MACHINE POURRAIT ETRE PLUS PERFORMANTE QUE LEUR PROPRE MEDECIN »

« C'EST UN COUT EN PLUS, 3000 EUROS DE DIFFERENCE AVEC UN CHIRURGIEN NORMAL SUR PERIGUEUX »

Christian Le Corre, patient à l'hôpital Haut Lévêque (CHU) de Pessac

COMMENT REAGISSENT LES PATIENTS ?

Delphine Maucort-Boulch

Médecin de santé publique et professeure en biostatistiques

Hospices Civils de Lyon

Cathérine Régis

Professeure de droit à l'Université de Montréal

Titulaire de la chaire de recherche du Canada en droit et politique de la santé

Le point sur la situation au Canada

Avez-vous eu des retours de patients sur le traitement de leurs données par l'intelligence artificielle ?

« Dans mon activité, je n'ai pas de contact direct avec les patients, mais j'ai eu l'occasion de rencontrer des associations de patients. Globalement, il y a à la fois un peu d'inquiétude, puisqu'il y a un fantasme généré autour de ce terme "Intelligence Artificielle", mais aussi une forme de sérénité : c'est quelque chose qui rentre dans la société, et est déjà présente sous différent aspects dans la vie des individus. Ceci étant, la réglementation RGPD, qui s'est imposée cette année, est aussi un garant pour les patients de l'utilisation de leurs données de façon générale. Dans ce cadre-là, il ne me semble pas qu'il y ait de raison pour que les patients soient davantage inquiets. »

Comment abordez-vous la question de l'éthique dans vos projets ?

« L’éthique est un des sujets majeurs à traiter dans les années qui viennent. Au sein des Hospices Civiles de Lyon nous avons créé la CIA (Commission Intelligence Artificielle), un groupe qui comporte des représentants du corps médical de différentes spécialités et des représentants de la DSII (Direction des Systèmes d’Information et d’Informatique). Sa mission est de travailler sur une charte, de donner des règles qui posent un cadre au niveau de l’institution pour le développement d’algorithmes, de méthodes, pour l'utilisation de ses approches. Son but est aussi d’aider les nouvelles méthodes et les projets à émerger et de les étendre à tous les services pour en faire profiter la communauté des médecins et des patients. C’est une commission qui travaille donc sur l’éthique et la façon dont se saisir des initiatives nationales. C’est sûr que cette réflexion, il faut la traiter au niveau national. Mais il faut faire en sorte de l’emmener dans un niveau supérieur, à l’échelle européenne au moins. »

Qu’on fasse confiance ou non à l’intelligence artificielle pour notre santé, ce domaine technologique pose des questions d’éthique. En effet, dans le but d’appréhender au mieux ces nouveaux défis, l’éthique est placée au coeur des préoccupations. L'innovation est rapide, et des règles doivent être érigées pour cadrer ces avancées.

Quand pour certains patients la relation avec leur médecin est primordiale, pour d’autres la machine permet un diagnostic plus personnalisé. Pourquoi est-ce si important d’aborder cette notion d’éthique ? Peut-il y avoir des problèmes ?

Catherine Régis

Professeure de droit à l'Université de Montréal et titulaire de la chaire de recherche du Canada en droit et politique de la santé

Enguerrand Habran

Directeur du Fond Recherche et Innovation de la Fédération Hospitalière de France

D’un point de vue éthique, est-ce que cela peut engendrer des problèmes ?

« Le problème ce n’est pas l’éthique dans l’intelligence artificielle, c’est l’humain qui est derrière. L’intelligence artificielle c’est un outil. Prenez une hache, il n’y a pas de problèmes sauf si vous la prenez pour tuer des gens. Le problème donc ce n’est pas la hache mais la personne qui tue avec. L’intelligence artificielle c’est la même chose. La problématique ce n’est pas l’éthique de l'algorithme lui-même, c’est l’algorithme de la personne qui va le développer et ce celui qui va l’utiliser.

La problématique qui est derrière c’est que sous prétexte d’analyse ou d’apprentissage, je capte l’information. Ca peut engendrer énormément de comportements qui ne sont pas éthiques. L’Intelligence Artificielle ne va pas prendre le contrôle de l’humanité, on ne voit ça que dans les films. Le problème c’est la personne qui est derrière l’intelligence artificielle. »

« L’intelligence artificielle soulève énormément de questions éthiques. On fait face à de nouvelles préoccupations, de nouveaux défis qui vont avoir des répercussions importantes dans le domaine de la santé. Mais il n’y a pas encore de normes de droit pures qui touchent à l’IA, on a donc un encadrement très flou. On doit développer une approche réflexive et éthique sur cette technologie, pour s’assurer qu’elle se construit de manière responsable. Cela va permettre d’orienter les décideurs dans les politiques, les lois et les règlements qu’ils pourront développer par la suite.

Au Canada on a la déclaration de Montréal sur le développement responsable de l'IA. Elle propose une boussole éthique pour l’accompagner, et la particularité d'être construite avec des experts mais aussi des citoyens, des professionnels et des décideurs. Elle a été écrite au terme d'un long processus de consultation, et elle est axée sur les préoccupations des citoyens. »

Pourquoi est-ce si important de parler d'éthique en IA ?

Delphine Maucort-Boulch

Médecin de santé publique et professeure en biostatistiques

Hospices Civils de Lyon

Comment peut-on créer un cadre éthique de l'IA alors que son développement est encore flou ?

« L'éthique, justement, nous permet d'avoir la capacité d'évoluer rapidement. Contrairement à elle, le droit évolue moins rapidement : c'est beaucoup plus exigeant et long de mettre en place des normes juridiques. Et même si l’on ne connaît pas encore tout, on a déjà une idée des problèmes et des défis qui vont survenir.

Cependant, il y a encore de grandes étapes à franchir, et des évolutions devront arriver: on dit que ce que l’on fait maintenant en IA, ce sera obsolète d’ici 5 ans. »

« Je pense que les progrès vont être fulgurants, et que l'IA va devenir de plus en plus présente dans les systèmes de santé. Il va donc falloir s'assurer que cette technologie se développe de manière responsable, qu’elle va être accessible à tous les patients en ayant des retombées pour l’ensemble de la société. C'est un enjeu fondamental, et on ne doit pas le penser après avoir développé la technologie, mais au moment où on le fait. Cela demande de réfléchir et de modifier nos pratiques pour être sûr que l'on vise cet objectif, qui doit être encouragé par les décideurs publics. »

Qu'en est-il de la notion de confiance ?

« Dans le milieu médical, la confiance c'est une notion primordiale. Elle est au cœur de la relation entre les professionnels de la santé et les patients. Mais quand je pose la question de savoir s’ils auraient plus confiance en un humain ou une machine, les avis sont assez partagés. Je pense que certaines personnes envisagent assez aisément que la machine pourrait être plus performante sur certains aspects que leur propre médecin. Mais il faut aussi se poser la question de savoir si une machine pourra intégrer des informations telles que vos aspirations de vie, vos valeurs, vos obligations personnelles ou professionnelles... Est-ce que ce qu'elle propose comme étant performant correspond vraiment à ce que vous voulez pour orienter le reste de votre vie concernant votre maladie ? »

Comment voyez-vous le futur de l'IA dans le domaine de la santé ?

François Talbot

Informaticien en charge des projets IA

Hospices Civils de Lyon

LES DIFFERENTES CLASSES D'OBJETS DE SANTE

ENTRETIEN

Hervé Debar, chercheur en cybersécurité à Télécom SudParis, Mehdi Siaghy, directeur de la recherche et de l'innovation au CHRU de Nancy ainsi que Racha Abu El Ata, directrice Santé et Social, Microsoft France nous en disent plus.

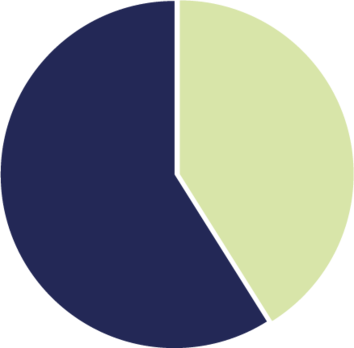

L’intelligence artificielle arrive dans les hôpitaux français. Quel est le ressenti des patients à ce sujet ? Sont-ils plutôt enthousiasmes ou opposés à cette pratique ? La réponse en images avec plusieurs patients des Hospices Civils de Lyon.

Retrouvez le questionnaire complet en cliquant ici.

« Il existe également d’autres caractéristiques possibles. Se focaliser sur celles-ci permet déjà de traiter l’impact des cyber-attaques sur l’homme, tant patient que soignant opérateur du matériel », ajoute Hervé Debar.

« Les objets passifs sont des capteurs ayant uniquement pour but de fournir une mesure, celle-ci n’ayant aucun impact sur le patient. On peut classer parmi ces objets la mesure de la fréquence cardiaque ou de la tension. »

« Les objets actifs ont une action curative sur le patient. Sont classés parmi ces objets les pacemakers, les pompes à insuline, ou les appareils de radiologie. »

« Les objets à mesure active sont des capteurs pour lesquels la prise de mesure peut avoir une conséquence pour le patient. Sont classés parmi ces objets les équipements d’imagerie médicale, qui demandent de soumettre le patient à des ondes pour capturer l’image, ou qui demandent l’injection de substances spécifiques pour faire ressortir des aspects de l’image. »

Hervé Debar, chercheur en cybersécurité à Télécom SudParis: